Inhaltsverzeichnis

1 Sinn und Zweck von Fleiss Kappa

Zur kurzen Einordnung: Fleiss’ Kappa berechnet die Interrater-Reliabilität zwischen mehr als zwei Personen (=Ratern). Damit dient es der Beurteilung von Übereinstimmung zwischen mindestens drei unabhängigen Ratern. Außerdem ist mit Kappa ersichtlich, wie sehr die Rater in ihren Urteilen übereinstimmen. Ein typisches Beispiel ist, ob drei Psychologen oder Ärzte bei ihren Diagnosen übereinstimmen und Patienten dieselben Krankheiten diagnostizieren oder eben nicht. Wenn es sich um nur zwei Rater handelt, ist Cohens Kappa zu berechnen.

2 Voraussetzungen zur Berechnung von Fleiss Kappa in SPSS

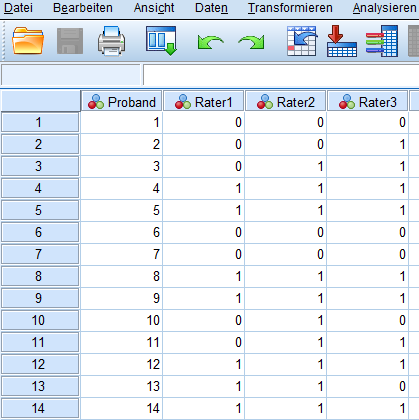

Für die Berechnung bedarf es lediglich einer nominalen Skalierung der zu prüfenden Variable. Die Einschätzungen der verschiedenen (hier genau drei) Rater sollten in verschiedenen Variablen, also spaltenweise vorliegen. In etwa so, wie im folgenden Bild. Hierbei bedeutet eine 0, dass die Rater keine Krankheit diagnostizierten. Eine 1 ist dementsprechend eine diagnostizierte Krankheit.

3 Berechnung von Fleiss’ Kappa in SPSS

3.1 SPSS Version 25 und früher

Standardmäßig war die Berechnung von Fleiss’ Kappa in SPSS bis einschließlich Version 25 nicht möglich. Hierzu gibt es aber ein Plugin von IBM. Leider bietet es IBM nicht mehr auf seinen Seiten an – man soll ja die neue Version kaufen. 😉

Das Plugin kann man bei allerdings hier noch herunterladen. Die .spe-Datei muss man dazu lediglich herunterladen und mit einem Doppelklick installieren (Achtung: es können Administrator-Rechte notwendig sein).

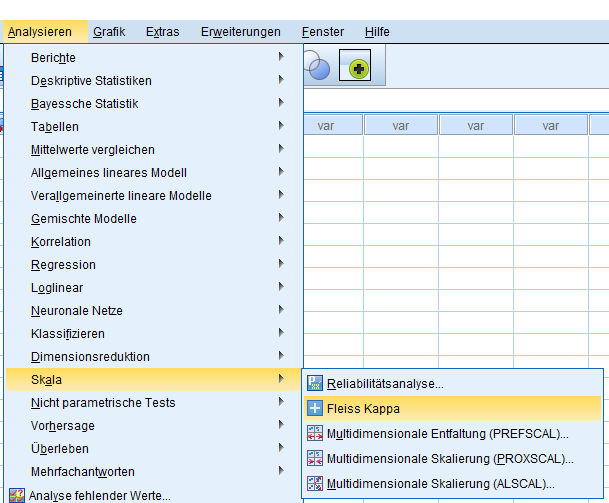

Nach der Installation ist Fleiss’ Kappa in Analysieren > Skala > Fleiss Kappa verfügbar:

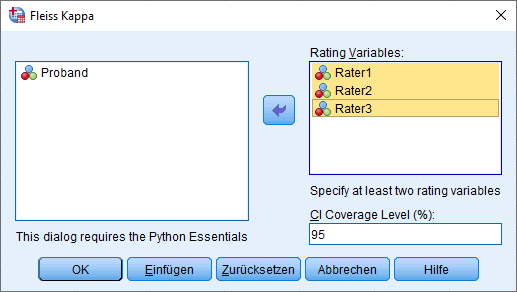

Nach dem Klick auf Fleiss Kappa erhält man folgendes Dialogfeld:

Sämtliche Rater, deren Urteilen verglichen werden sollen, müssen nach rechts geschoben werden. In meinem Fall sind das 3 Rater. Weitere Einstellmöglichkeiten existieren nicht und man kann mit OK die Berechnung ausführen.

3.2 SPSS Version 26 und später

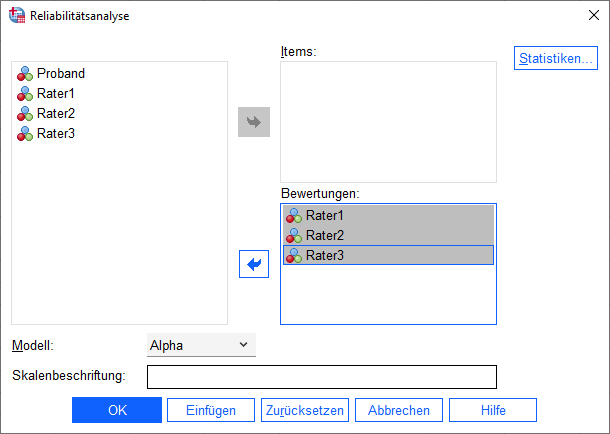

Ab Version 26 von SPSS ist Fleiss’ Kappa standardmäßig implementiert. Ihr findet es unter Analysieren > Metrisch> Reliabilitätsanalyse.

Hier sind die Rater und deren Urteile in das Feld Bewertungen zu schieben.

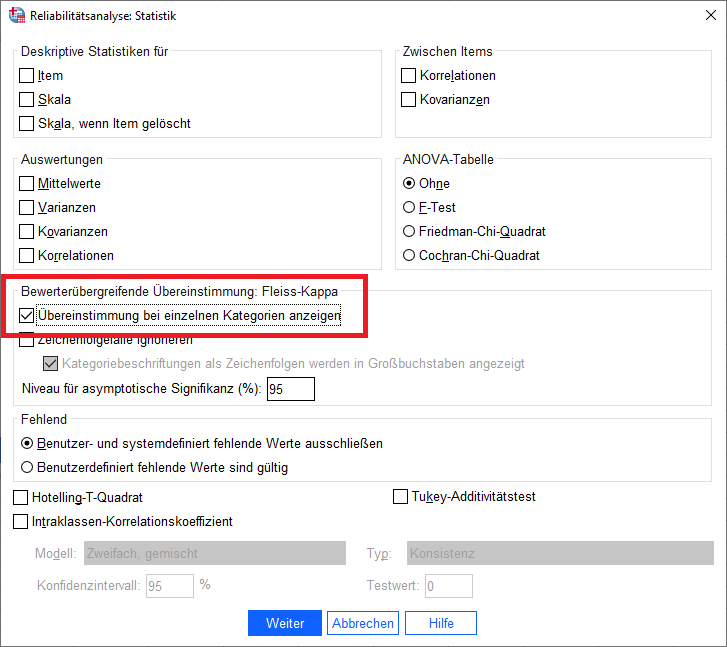

Als Nächstes ist Statistiken auszuwählen. Im folgenden Dialogfeld ist im Bereich Bewerterübergreifende Übereinstimmung: Fleiss-Kappa der Haken bei Übereinstimmung bei einzelnen Kategorien anzuhaken. Danach geht es mit Weiter und OK zur Auswertung.

4 Interpretation der Ergebnisse von Fleiss’ Kappa in SPSS

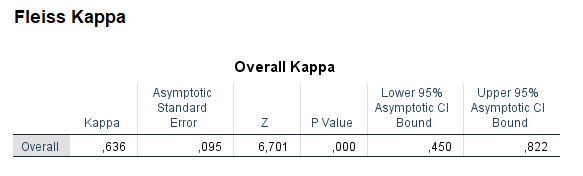

SPSS gibt nun zwei Tabellen aus. “Overall Kappa” und “Kappas for Individual Categories”. Interessant ist nur die erste Tabelle mit “Overall Kappa”, welche unten steht:

In dieser Ergebnistabelle interessieren uns nur zwei Werte.

- Der eine ist Kappa selbst und er beträgt 0,636.

- Der zweite relevante Wert steht in der vierten Spalte und ist die Signifikanz (p). Sie beträgt ,000.

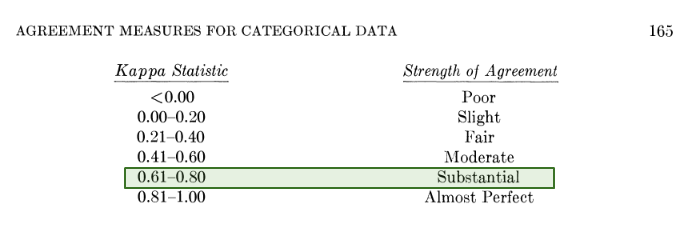

Die Übereinstimmung anhand von Fleiss Kappa ist somit statistisch signifikant. Schließlich stellt sich die Frage, wie hoch die Übereinstimmung des Wertes 0,636 ist. Theoretisch kann sie zwischen perfekt (1) und schlecht (0) sein. Im Beispiel ist die Übereinstimmung beachtlich (“substantial”). Hierzu dient folgende Systematisierung nach Landis und Koch (1977).

5 Literatur

- Fleiss, J. L. (1971) “Measuring nominal scale agreement among many raters.” Psychological Bulletin, Vol. 76, No. 5 pp. 378–382

- Landis, J., & Koch, G. (1977). The Measurement of Observer Agreement for Categorical Data. Biometrics, 33(1), 159-174. doi:10.2307/2529310

6 Videotutorial